树

抽象代数

jedec

产品经理

脑电

PID

https

双目相机

业务大屏

医学统计学

反码

vue3组件

skill

支持向量机

rpa

netty

编程开发

服务容错

光纤光栅

u-boot

预训练语言模型

2024/4/13 3:47:23各种预训练模型的理论和调用方式大全

诸神缄默不语-个人CSDN博文目录

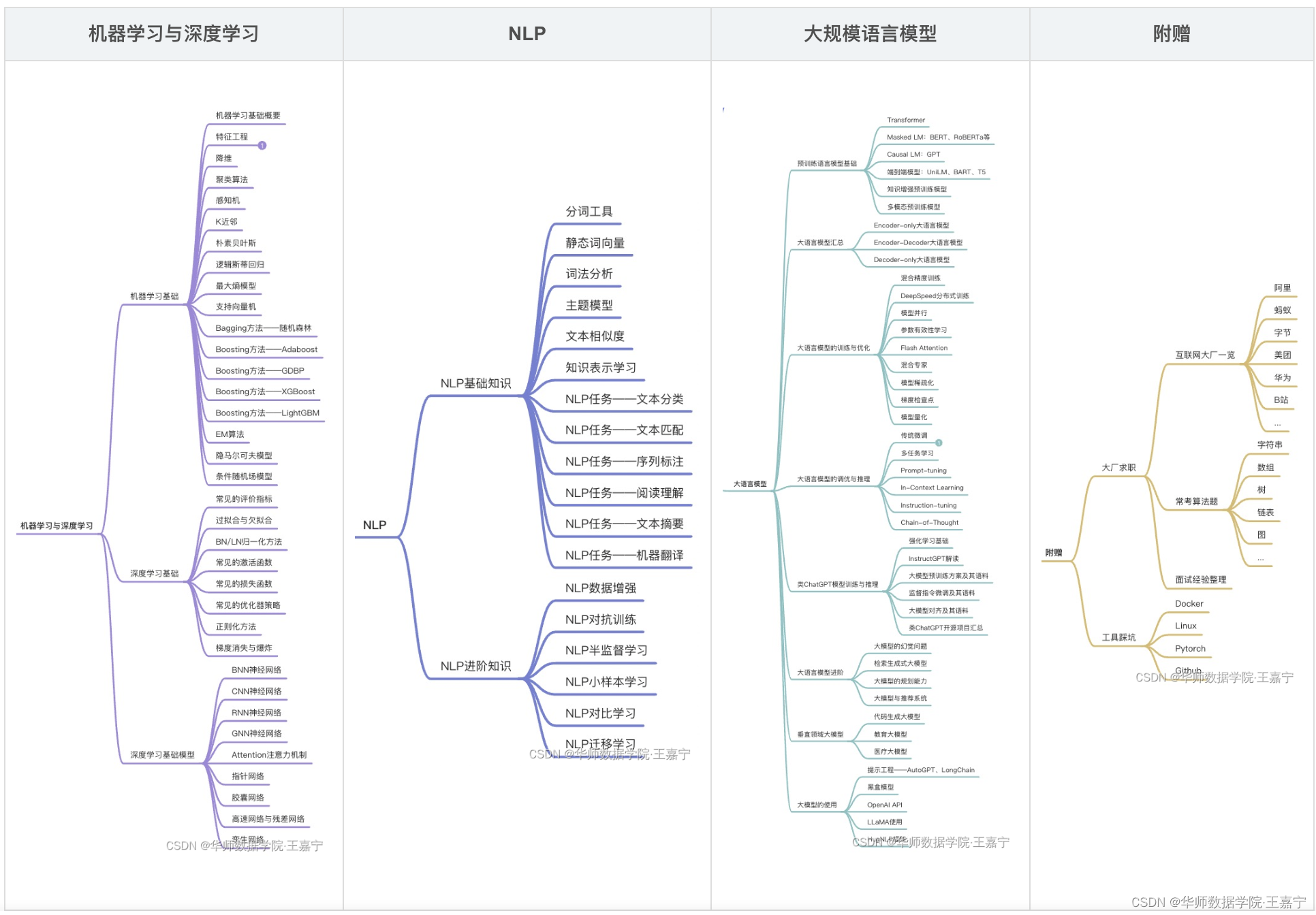

本文主要以模型被提出的时间为顺序,系统性介绍各种预训练模型的理论(尤其是相比之前工作的创新点)、调用方法和表现效果。

最近更新时间:2023.5.10 最早更新时间:2023.5.10

BertRobe…

【LLMs】从大语言模型到表征再到知识图谱

从大语言模型到表征再到知识图谱 InstructGLMLLM如何学习拓扑?构建InstructGLM泛化InstructGLM补充参考资料 2023年8月14日,张永峰等人的论文《Natural Language is All a Graph Needs》登上arXiv街头,轰动一时!本论文概述了一个名…

【AI理论学习】语言模型:BERT的优化方法

语言模型:BERT的优化方法 图解XLNet模型1. 排列语言模型(Permutation Language Modeling)2.XLNet融入Transformer-XL理念3. 使用双流自注意力机制(Two-Stream Self-Attention)Permutation Language Modeling带来什么问…

【通览一百个大模型】Baize(UCSD)

【通览一百个大模型】Baize(UCSD) 作者:王嘉宁,本文章内容为原创,仓库链接:https://github.com/wjn1996/LLMs-NLP-Algo 订阅专栏【大模型&NLP&算法】可获得博主多年积累的全部NLP、大模型和算法干货…

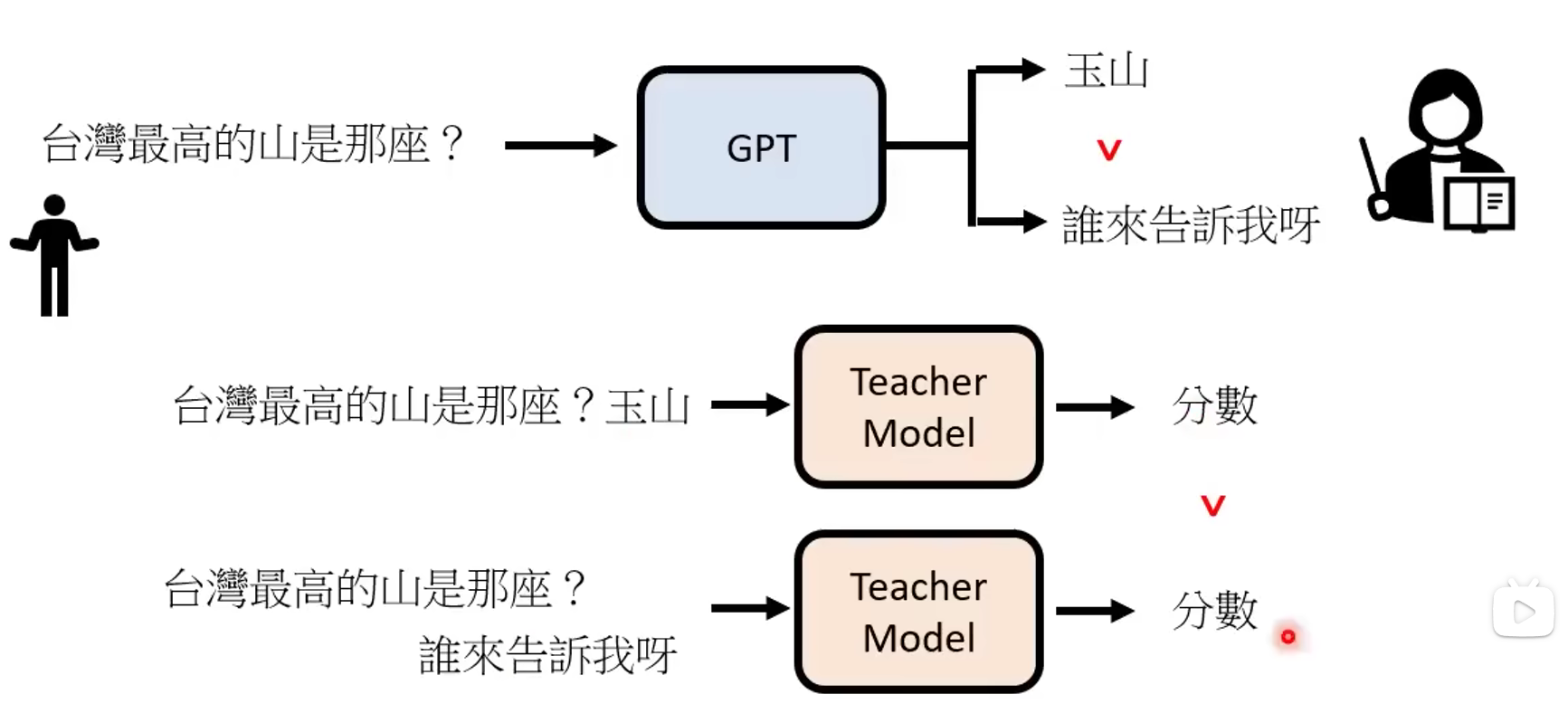

【期末复习向】长江后浪推前浪之ChatGPT概述

参考文章:GPT系列模型技术路径演进-CSDN博客

这篇文章讲了之前称霸NLP领域的预训练模型bert,它是基于预训练理念,采用完形填空和下一句预测任务2个预训练任务完成特征的提取。当时很多的特定领域的NLP任务(如情感分类,…